Parliamo spesso di intelligenza artificiale; abbiamo visto i suoi punti di forza e anche gli aspetti più problematici invece nella puntata di questa settimana abbiamo cercato di dare un “corpo” a questa intelligenza. Nello specifico parleremo di robotica portando l’esempio di iCub, il robot umanoide ideato dall’Istituto Italiano di Tecnologia per fare ricerca in questo ambito. Per aiutarci a capire le potenzialità di iCub abbiamo fatto una chiacchierata con Elisa Maiettini, ricercatrice dell’Istituto Italiano di Tecnologia nell’ambito Humanoid Sensing and Perception.

Nella sezione delle notizie invece parliamo di microrobot per combattere il cancro e della missione di NASA e ASI per deviare un asteroide.

Immagini

• Foto copertina: A.Abrusci/D.Farina per IIT

Brani

• Ecstasy by Rabbit Theft

• No Pressure by Tim Beeren & xChenda

Non sarà nel prossimo anno, forse nei prossimi cinque, ma nell'ottica di un inserimento di un robot nella realtà di tutti i giorni, il fatto di avere una struttura umanoide dei processi ispirati comunque all'uomo, permetterà di agevolare l'introduzione di questi robot nel mondo perché il mondo è costruito a misura d'uomo.

Salve a tutti, siete all'ascolto di INSiDER - Dentro la Tecnologia, un podcast di Digital People e io sono il vostro host, Davide Fasoli.

Oggi parleremo con l'Istituto Italiano di Tecnologia di robotica umanoide e di come il progetto iCub stia aiutando la ricerca scientifica in tutto il mondo.

Prima di passare alle notizie che più ci hanno colpito questa settimana, vi ricordo che potete seguirci su Instagram a @dentrolatecnologia, iscrivervi alla newsletter e ascoltare un nuovo episodio ogni sabato mattina, su Spotify, Apple Podcast, Google Podcast oppure direttamente sul nostro sito.

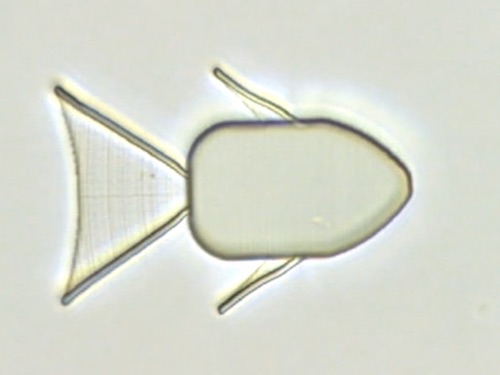

Un gruppo di scienziati cinesi ha realizzato dei microrobot che potranno essere utilizzati nella lotta contro il cancro.

Questi microrobot non sono altro che minuscole strutture in "idrogel" stampate in 3D, la cui caratteristica principale è quella di essere biocompatibile.

I microrobot realizzati hanno diverse forme, tra cui quelle di un pesce e di un granchio, e dopo la stampa vengono immersi in una soluzione di ossido di ferro.

In questo modo, i loro movimenti potranno essere guidati dall'esterno grazie ad un campo magnetico, esattamente come quando si sposta del ferro con una calamita.

Infine, i microrobot reagiscono al cambio di acidità, ad esempio aprendo o chiudendo le chele o la bocca.

Grazie a questa particolarità, quindi, i ricercatori hanno dimostrato che è possibile trasportare e rilasciare dei farmaci in specifiche zone del corpo.

E nel caso di una chemioterapia, questo significherebbe colpire in modo mirato le sole cellule interessate, riducendo al minimo gli effetti collaterali.

Ovviamente, questi sono solo dei primi prototipi, e i microrobot necessitano di ulteriori studi e ulteriori migliorie, ma è sicuramente un passo importante verso il futuro della medicina.

Alle 7.20 di mercoledì 24 novembre è partito da una base di lancio in California il razzo Falcon 9 di SpaceX, con a bordo la sonda del programma DART, acronimo di Double Asteroid Redirection Test, che avrà come obiettivo quello di colpire un piccolo asteroide a milioni di chilometri di distanza dal nostro pianeta.

Il test, voluto da NASA, servirà per capire se sia possibile deviare l'orbita di un corpo celeste, nel caso in cui un giorno dovesse realmente presentarsi la minaccia di un asteroide in rotta di collisione con la Terra.

Ed insieme alla sonda principale, che avrà il compito di schiantarsi sul corpo celeste per deviarne appunto la traiettoria, è partito anche LICIACube, ovvero un piccolo satellite grande quanto una scatola di scarpe finanziato e gestito da ASI, con

cui abbiamo parlato nella puntata Agenzia Spaziale Italiana, l'innovazione passa dallo spazio, la cui missione sarà quella di registrare e monitorare lo scontro tra la sonda e l'asteroide.

Parliamo spesso di intelligenza artificiale, abbiamo visto i suoi punti di forza e anche gli aspetti più problematici.

Oggi però cercheremo di dare un corpo a questa intelligenza.

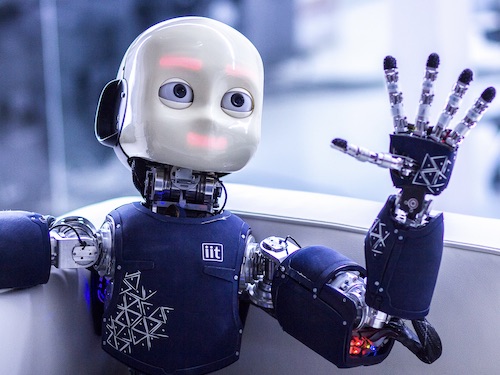

Nello specifico parleremo di robotica portando l'esempio di iCub, il robot umanoide ideato dall'Istituto Italiano di Tecnologia per fare ricerca in questo ambito.

Per spiegarci cos'è iCub è con noi Elisa Maiettini, ricercatrice dell'Istituto Italiano di Tecnologia.

Benvenuta Elisa.

Ciao a tutti, grazie.

Innanzitutto ci spieghi che cos'è iCub e qual'è il suo principale utilizzo.

Si, dunque iCub è un robot cosiddetto umanoide, cioè antropomorfo, all'aspetto di un umano nella fattispecie di un bambino in questo caso, nasce da una base di ricerche nei primi degli anni 2000 e è il primo prototipo realizzato e presentato, ha visto la luce nel 2009 circa, intorno al 2009-2010.

Sostanzialmente è una piattaforma di ricerca open source, sia dal punto di vista hardware che dal punto di vista software, che permette di sviluppare e portare avanti ricerca d'avanguardia per quanto riguarda la robotica umanoide un po in tutto il mondo.

Qualche dettaglio così interessante è che iCub ha 53 gradi di libertà, cosa vuol dire che ha 53 parti del corpo che possono essere controllati in maniera individuale, quindi produrre dei movimenti naturali tra braccia, gambe, dita, collo, testa, eccetera.

Ok e all'interno di questo progetto, tu di che cosa ti occupi come ricercatrice?

Io sono entrata a fare parte di uno dei gruppi che lavora su iCub, che si chiama Humanized Sensing and Perception, circa cinque anni fa, anno in cui ho iniziato il mio dottorato di ricerca e all'interno di questo gruppo mi occupo dell'aspetto di

visione e intelligenza artificiale, quindi dello sviluppo di algoritmi di machine learning che permettono al robot di imparare in maniera efficiente a riconoscere, localizzare, distinguere i diversi oggetti, le diverse parti di un'immagine come arrivano dalle telecamere posizionate sui suoi occhi.

Quindi in particolare nel nostro gruppo ci occupiamo anche di altri aspetti legati alla percezione come per esempio utilizziamo una tecnologia di sensori capacitivi posizionata sulla scocca di iCub che simula la sensibilità della pelle umana per

esempio, quindi permette al robot di capire dove e con quale intensità avviene un contatto con le sue parti del corpo per esempio.

Su questo ultimo aspetto che ci hai evidenziato, da quello che ho visto iCub è se non l'unico uno dei pochissimi robot al mondo che hanno questa caratteristica, giusto?

Sì, esatto, la tecnologia che sta dietro a questa pelle se così la vogliamo chiamare è sviluppata proprio all'interno di ITT ed è tra le uniche al mondo che esistono e sicuramente iCub è uno dei pochi robot che ha questa capacità.

E perché è importante che un robot umanoide abbia questa capacità?

Per quanto riguarda questa pelle, questa capacità di percepire il contatto, una delle applicazioni e una delle motivazioni forse più evidenti è quella per la sicurezza per esempio.

Infatti, per esempio, posizionare questa pelle sulle braccia di iCub permette di, una volta toccato, una volta riconosciuto un contatto con una persona o con un oggetto fisico, di interrompere un movimento, quindi per motivi di sicurezza il fatto di

avere un robot che riconosce gli urti, per così dire, ha l'utilità di poter interrompere il processo o aggiustarlo a seconda dell'evenienza.

Un altro esempio pratico in cui questa pelle torna ad essere utile è negli esperimenti di presa di oggetti.

Infatti, questa stessa pelle l'abbiamo posizionata anche sulle dita, sui polpastrelli delle dita di iCub e permette di aggiustare la presa intorno agli oggetti o appunto intorno ad altri corpi fisici, in corrispondenza del feedback che arriva da questi sensori.

Sì, quindi da quello che ci stai facendo capire, iCub è un robot che è pensato per coesistere in un contesto con l'essere umano e quindi la domanda che ti potrei fare adesso è, qual è il senso, la necessità di costruire un robot umanoide?

E quando si progetta un robot di questo tipo, anche da un punto di vista estetico, ci sono degli accorgimenti da considerare perché penso che per una persona trovarsi davanti ad un robot ad esempio molto realistico possa fare innescare delle reazioni psicologiche, perché magari appunto c'è troppa somiglianza con l'essere umano.

Sì, esatto, per quanto riguarda l'aspetto umanoide, hai detto bene tu, possiamo distinguere tra un aspetto più tecnico e un aspetto più psicologico.

Per quanto riguarda l'aspetto tecnico, l'avere un robot umanoide ha vantaggi e svantaggi.

Lo svantaggio evidente è che l'organismo umano che iCub o comunque un robot umanoide cerca di emulare un organismo estremamente complesso e cercare di riprodurlo introduce un livello di complessità molto elevato che spesso in alcune situazioni può rendere alcuni task molto difficili.

D'altra parte però ha numerosi vantaggi, soprattutto con una prospettiva a lungo termine.

Infatti, un vantaggio a lungo termine è il fatto che, non sarà nel prossimo anno, forse nei prossimi cinque, ma nell'ottica di un inserimento di un robot nella realtà di tutti i giorni, il fatto di avere una struttura umanoide dei processi

ispirati comunque all'uomo permetterà di agevolare l'introduzione di questi robot nel mondo, perché il mondo è costruito a misura d'uomo.

Poi c'è tutto l'aspetto un po più psicologico, come dicevi tu, e rispetto a questo c'è uno studio, mi sembra, dei primi anni 70, chiamato "uncanny valley", per cui è stata studiata la reazione che questi robot umanoidi suscitavano nelle persone comuni che non ci lavoravano.

Ed è stato visto che, in realtà, il grado di accettazione di questi robot cresceva man mano che il robot diventava più simile esteticamente alle persone fino ad un certo punto di rottura.

Quindi, dopo un certo punto, il fatto di essere troppo vicino all'essere umano li rendeva quasi ripugnanti e generavano delle sensazioni negative su questi utenti che ci avevano a che fare e quindi c'è questo punto un po delicato da trovare per cui

vuoi riprodurre in un certo senso parti dell'organismo umano o parti del suo comportamento, ma senza andare troppo oltre.

Sì, nel vostro caso avete progettato un robot umanoide per fare ricerca sulle sue capacità in tutti quegli ambiti in cui un robot potrebbe sostituire l'uomo, mi viene in mente una situazione estremamente pericolosa che metterebbe a repentaglio la vita di un essere umano.

Però tutto questo con un robot che ha un aspetto, diciamo, non in cute timore perché ha le dimensioni di un bambino.

Sì, esatto, sostituire o in realtà collaborare con gli umani in qualche modo, in qualche task e sì, infatti la fisionomia richiama chiaramente quella di un bambino, ma per farti un esempio ci sono alcuni prototipi provenienti da altre case giapponesi che mimano anche la pelle umana in termini di estetica, che possono risultare…

E quello forse è eccessivo per l'impatto psicologico che potrebbe avere una persona nel vederlo.

Probabilmente sì, probabilmente sì, poi è soggettivo, però diciamo che potrebbe.

Passiamo appunto all'intelligenza di iCub, ci spieghi perché anche sotto questo punto di vista l'intelligenza artificiale di iCub è diversa dalle altre intelligenze artificiali che conosciamo?

Dunque innanzitutto forse va data una definizione di intelligenza artificiale, nel senso che ha questo concetto un po fumoso che dipende un po dai settori, viene implementata in modi diversi, se per intelligenza artificiale intendiamo l'insieme delle

capacità di cui iCub o un robot sono forniti che possono essere assimilabili ad un'intelligenza, sicuramente iCub per il fatto di essere umanoide, per il fatto di essere open source e per il fatto quindi di essere condiviso da tanti laboratori di

ricerca ha sviluppato nel corso degli anni e tutti questi laboratori di ricerca ha una serie di capacità molto diverse e ciascuna diciamo molto interessante, quindi per esempio abbiamo parlato di quello che facciamo noi nel nostro gruppo, nel gruppo di cui faccio parte, per quanto riguarda la visione, per quanto riguarda la pelle.

Poi ci sono altri gruppi in cui hanno iCub leggermente diversi, perché non tutti gli iCub sono uguali, hanno un iCub per esempio con delle telecamere al posto degli occhi che sono diverse da quelle a colori che utilizzo io, quelle normali che

possiamo conoscere, ma sono cosiddette ad eventi in cui sono particolarmente efficienti per alcune applicazioni perché non mandano uno stream di immagini continuo, ma mandano un'informazione solo nel momento in cui viene percepito un evento, quindi soltanto nel momento in cui si muove qualcosa nella scena, per esempio.

E questo è un altro tipo di capacità che RobotEye su cui altri ricercatori stanno lavorando.

Oppure c'è tutta la parte più di dinamica e di movimento, quindi ci sono gruppi di ricerca che studiano come far camminare iCub, come fargli mantenere l'equilibrio in certe circostanze e così via.

Le capacità che iCub ha accumulato nel corso degli anni vengono da tutti questi laboratori di ricerca che in qualche modo hanno contribuito al successo della piattaforma.

Sì, quindi un'unica struttura di base che poi può essere ampliata e modificata con un'intelligenza artificiale che viene sviluppata anche in base alle necessità che si hanno in quel determinato ambito di ricerca.

Esatto, esatto.

E a proposito di ricerca, non è scontato che iCub sia un progetto open source, e cioè che le istruzioni per costruirlo e il programma per farlo funzionare sono pubblici.

Perché è stata scelta la filosofia dell'open source e che impatto ha avuto sullo sviluppo di iCub?

Sì, infatti, il perché deriva dal fatto che iCub è un progetto di ricerca e nella ricerca uno degli aspetti fondamentali è la condivisione di ciò che si è raggiunto, diciamo, per permettere ad altri ricercatori di partire da quel punto d'arrivo e renderlo per loro un punto di partenza per altri tipi di ricerca.

Quindi in questo senso è come se ogni volta non dovessimo rinventare l'acqua calda e quindi avere una piattaforma open source in cui sia i progetti hardware che tutta la parte di codice sono disponibili online e utilizzabili ha permesso a diversi

gruppi di ricerca di adottare questa piattaforma e poter costruire sulla base comune che era disponibile.

A loro volta questi gruppi di ricerca possono poi collaborare e contribuire al progetto rendendo pubblici i loro raggiungimenti e quindi andare in un loop virtuoso a crescere in termini di ciò che si sa in robotica e ciò che si può fare in robotica.

L'impatto che ha avuto è in parte quello, che viene da questa motivazione, quindi innanzitutto ci sono più di 40 iCub sparsi nel mondo, molti in Europa, alcuni in Giappone, quindi ci sono veramente tante piattaforme distribuite tra università, istituti di ricerca.

Uno dei contributi, non l'unico, ma uno dei contributi che ha avuto forse più impatto nello sviluppo di iCub è quello banalmente del report di problemi, quindi il fatto che utilizzando una piattaforma, noi che l'abbiamo sviluppata, o meglio chi

l'ha sviluppata poi, noi la utilizziamo per un certo scopo e in un certo senso potremmo vedere magari una porzione limitata di utilizzi, mentre portandola in altri laboratori di ricerca con altri scenari di utilizzo ha permesso di testarlo in

condizioni delle più disparate in modo da individuare dei problemi che non avremmo potuto trovare, quindi rendere la piattaforma più generale possibile e migliorata.

Infatti questo ha portato poi nel corso degli anni ad avere più versioni di iCub, che sta anche crescendo in termini di estatica fisica e quindi un miglioramento continuo della piattaforma.

Sì, quindi una condivisione per affinare e migliorare ulteriormente questa piattaforma di ricerca.

Quindi abbiamo capito che iCub è un progetto di ricerca e proprio per questo dubito lo vedremo in ambiti industriali.

Ci puoi però spiegare quale impatto concreto può comunque avere e ancora di più in futuro potrà avere sulla nostra vita?

Sì, dicevi bene, è molto improbabile che avremo un robot umanoide della portata di iCub, quindi della complessità di iCub in casa o in uno scenario di vita quotidiana sicuramente.

Quindi da questo punto di vista non ci siamo ancora.

Però è anche vero che le tecnologie che sviluppiamo su iCub possono essere riutilizzate e in un certo senso riciclate separatamente in scenari più contenuti e di più semplice gestione.

Per esempio, si potrebbe pensare di utilizzare la tecnologia di visione, gli algoritmi che abbiamo sviluppato nel nostro gruppo su piattaforme più semplici di iCub, magari sempre umanoidi o magari non umanoidi, in un certo senso sfruttano la

tecnologia e noi abbiamo sfruttato la tecnologia umanoide per sviluppare queste tecnologie, questi algoritmi, ma poi questi possono essere riutilizzati anche in altre piattaforme.

Oppure l'utilizzo e le tecnologie che produciamo come ricerca possono essere utilizzate anche in ambiti completamente diversi.

Per esempio, la pelle ha sensori capacitivi di cui parlavo prima, può essere montata su iCub e fare la funzione di pelle, ma può essere usata come sensore di contatto e di pressione in altri contesti e già infatti la stiamo applicando anche ad altri settori.

Oppure per esempio alcuni algoritmi di controllo, tecnologie che abbiamo sviluppato per la mano o per afferrare gli oggetti o comunque per muovere il braccio possono essere riportati a dei progetti in cui le stesse tecnologie vengono utilizzate per costruire protesi per esempio per persone amputate.

Quindi ci hai parlato di diverse ricerche condotte sulla piattaforma iCub in tutto il mondo e quindi la ricerca potenzialmente può concentrarsi anche su una parte del robot?

Penso ad un braccio, una gamba, il sistema di divisione?

Sì, la ricerca su iCub è costituita da una rete di persone che ognuno di ricercatori in cui ciascun gruppo o ciascuna persona si occupa di una parte specifica poi queste vengono integrate e quello che vediamo ne è il risultato.

Ma le singole tecnologie che vengono sviluppate possono essere riutilizzate anche in altri settori.

In conclusione, volendo anche ampliare la prospettiva, andando oltre anche al progetto iCub, qual è secondo il tuo punto di vista di ricercatrice il ruolo che avranno in futuro all'interno della nostra società i robot?

Perché è vero che oggi non siamo circondati, non viviamo a fianco di robot umanoidi, non siamo abituati a vederli, però in realtà comunque i robot rappresentano una parte importante della nostra vita perché la maggior parte dei dispositivi che abbiamo con noi sono in grande parte prodotti da dei robot.

Ma quale sarà appunto in futuro il loro ruolo all'interno della nostra società?

Sì, diciamo come hai detto tu i robot sono già tra noi tanto per fare un po di un claim forte e in particolare quello che vedo come prospettiva un po a breve termine e che sta già avvenendo in termini di ricerca e credo anche in alcuni ambiti

applicato alla vita reale è di robot non umanoidi ma collaborativi, quindi il fatto che piattaforme robotiche possono essere utilizzate per agevolare alcuni task alle persone o per evitare problemi.

Un esempio può essere come dicevi tu in ambito industriale i bracci meccanici che diciamo possono svolgere dei task in maniera automatica, poi ci sono dei filoni di ricerca in cui questi bracci meccanici collaborano, viene studiato il modo più

sicuro e intelligente per far collaborare questi bracci meccanici con l'operatore del macchinario in ambito industriale.

Altro tipo di aiuto, agevolazione che la robotica può portare in questi settori è per esempio sotto la forma degli esoscheletri, l'esoscheletro è un tipo particolare di piattaforma robotica che può essere indossato da un operatore e in alcune

situazioni può sgravare un peso portato dall'operatore oppure aiutarlo in alcuni movimenti particolarmente usuranti altrimenti.

Quindi sicuramente questo è qualcosa che sta avvenendo e lo vedo come un impatto a breve termine.

Sul lungo termine, dato che lavoro con robot umanoidi, mi viene da dire che in un futuro avremo dei robot umanoidi che potranno collaborare con noi, inizialmente non saranno del grado di complessità di iCub, saranno più semplici, magari non avranno

le gambe, avranno le ruote, oppure noi stessi come ITT abbiamo prodotto un altro robot che non è iCub, sempre umanoide con delle semplificazioni in termini di materiali, giunti alle ruote e una delle applicazioni per cui potrebbe essere utilizzato

un robot di questo tipo umanoide, potrebbe essere in scenari di riabilitazione, per esempio alcuni dei miei colleghi hanno testato già questo robot, quest'altra seconda piattaforma di cui ti parlavo, in questi scenari di riabilitazione in cui il

paziente deve svolgere dei movimenti e il robot osserva i suoi movimenti, capisce se sono fatti nel modo giusto o nel modo sbagliato e se necessario mostra il movimento giusto da svolgere così da correggere il paziente.

Bene Lisa, grazie per averci parlato di robot, del vostro progetto di ricerca e appunto come hai risposto a questa ultima domanda, abbiamo sicuramente avuto modo di affrontare il tema in modo estremamente ampio e in modo estremamente chiaro.

Grazie, buon lavoro e alla prossima.

Grazie Davide, a presto, ciao.

E così si conclude questa puntata di INSiDER - Dentro la Tecnologia, io ringrazio come sempre la redazione e in special modo Matteo Gallo e Luca Martinelli che ogni sabato mattina ci permettono di pubblicare un nuovo episodio.

Per qualsiasi tipo di domanda o suggerimento scriveteci a redazione@dentrolatecnologia.it, seguiteci su Instagram a @dentrolatecnologia dove durante la settimana pubblichiamo notizie e approfondimenti.

In qualsiasi caso nella descrizione della puntata troverete tutti i nostri social.

Se trovate interessante il podcast condividetelo che per noi è un ottimo modo per crescere e non dimenticate di farci pubblicità.

Noi ci sentiamo la settimana prossima.